(二)现有VR的产品设备及原理

2.现有VR的产品设备及原理

2.1VR产品设备

1、头戴显示设备

头戴显示设备就是传统的VR一体机,也可以叫做主机端头戴显示设备,比较有代表性的便是三大厂商的产品:

(1)Oculus Rift

上图中,最左边的为进行动作捕捉的传感器,中间的便是头戴显示主机,右边的是操作手柄(Xbox专门为游戏定制手柄)。

(2)HTC Vive

图中两个长型手柄代表我们在VR世界中的两只手,所有的交互操作都需要通过这两个手柄来操作;两个方形的物体是基站,可以提供360度的移动追踪(针对两只手柄的位移)。

(3)Sony PlayStation VR

索尼的设备也基本和前两者一致。

目前,国内的显示设备厂商中很大一部分都在做这类一体机产品,比如大朋、3Glasses、UCglass、蚁视、游戏狂人、EMAX、VRgate等,但与三大厂商还存在较为明显的差距。

由于一体机需要将显示、计算、存储、电源等功能性模块全部集成到头戴显示设备中,要达到好的性能,显示设备就很难做到轻便小巧,所以这些设备使用者佩戴起来普遍比较沉重,头部会承受较大的压迫感,不能长时间佩戴。

2、输入设备

手柄是主流的游戏输入设备,是最早大规模使用的VR输入外设。Oculus、HTC、Sony、Gear VR产品都采用或兼容手柄。

上图中为双6DOF控制器Oculus Touch是迄今为止最好的VR手柄,这种输入设备能为用户带来更高级的沉浸化交互体验。但目前而言,其操作体验还没能做到和现实世界中一致,比如我抓住弓弦拉开一把弓然后放箭射靶的操作,在VR中就是两只手按下Oculus Touch上的按钮然后两手分开一定距离,再释放按键(现实世界中所有的拿捏拖压动作在VR中都整合为按下手柄上的按键),有一定的不同。

全身动作捕捉能获取到更完整的动作信号,实现更丰富的交互。代表性的产品/公司有:诺亦腾(全身动作捕捉)、Kinect(微软体感输入)、奥比中光(深度摄像头)等。但是因为使用者手上没有佩戴设备,所以就缺少了作用力这一重要的操作反馈,导致真实性不够强。

其他输入模式还包括手势追踪,最著名的当属Leap Motion。

上图VR眼镜的前部圆角矩形模块即Leap Motion,它搭载在VR主机设备上对手势动作进行跟踪捕捉,然后再反馈于虚拟世界的物体上。在交互操作上较Oculus Touch它更加接近现实世界中用户的真实动作,完全释放了用户的双手,实现更加多样的操作模式。我还未试过Leap Motion,不过到目前为止看到过的演示都是非常赞的。

3、移动VR眼镜

2014年6月,Google在I/O大会上发布了Cardboard,从此掀起了眼镜盒子类产品的风潮。

2014年9月,三星发布了Gear VR,成为了迄今为止性能和体验最好的眼镜盒子产品。针对特定型号手机定制开发的眼镜盒子提供更好的体验。

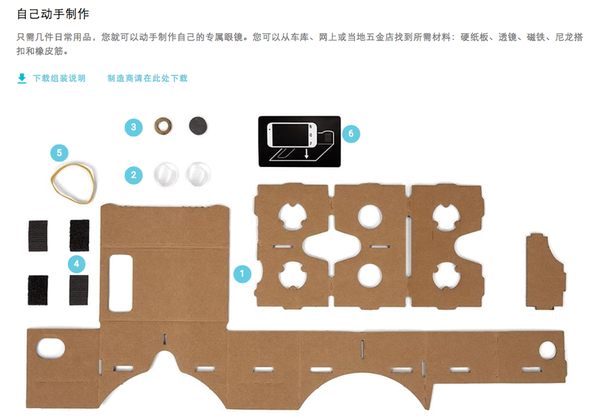

这里详细介绍一下Google的Cardboard,它的硬件结构非常简单,只有几张瓦楞纸和两个透镜组成,官网中可以下载眼镜的组件及尺寸图,动手能力强的同学可以自行制作。

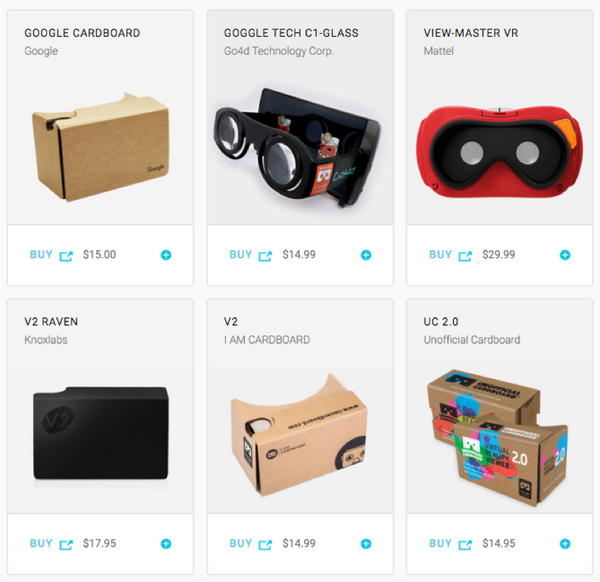

现在Cardboard已衍生出各种样式的产品,价格基本在15-30刀不等(略微小贵,但这个不用怕,咱有大淘宝~)。

4、JUMP

提到Google Cardboard就不得不提一下其VR视频录制设备JUMP,简而言之,Jump 是一个摄像机阵列,装备有16 个呈圆形阵列的摄像机模块构成,在尺寸及模块排列上都经过精心调整。它可以捕捉到全方位 3D 效果、完美的 360 度、高分辨率的视频:

(1)借助 Jump,任何人都能以虚拟现实视频(带给您身临其境感觉的视频)的形式捕捉世界的精彩,并与所有人分享。Jump 会组合出 360 度视频,让您从任何角度都能感受场景;

(2)完美立体效果,能如实反映物体的远近位置。其 3D 拼接方法可以制作精美无缝的全景视频,拼接之处不留痕迹;

(3)编译后的 3D 视频具有超高分辨率,相当于 5 个 4k 电视同时播放。

拍摄完的视频需要通过JUMP 编译器处理,运用先进的计算机视觉功能和强大的计算能力,能将 16 个视频转换为立体的虚拟实境视频。

在YouTube上有很多人使用JUMP拍摄的视频。

2.2VR的原理

1、立体图像

人之所以能够看到立体的景物,是因为我们的双眼可以各自独立看东西,左右两眼有间距,造成两眼的视角有些细微的差别,而这样的差别会让两眼个别看到的景物有一点点的位移。就像我们观看一个物体时,其实左眼和右眼看到的画面是不一样的,人类的大脑很巧妙地将两眼的图像融合,产生出有空间感的立体视觉效果在大脑中。3D立体眼镜,就是通过控制主机输出立体讯号(左眼图像和右眼图像)到屏幕,使其同步切换左、右眼图像,换句话说,左眼看到左眼该看到的景像,右眼看到右眼该看到的景像,让这个视差持续在屏幕上表现出来。

2、拍摄视频中物体的深度

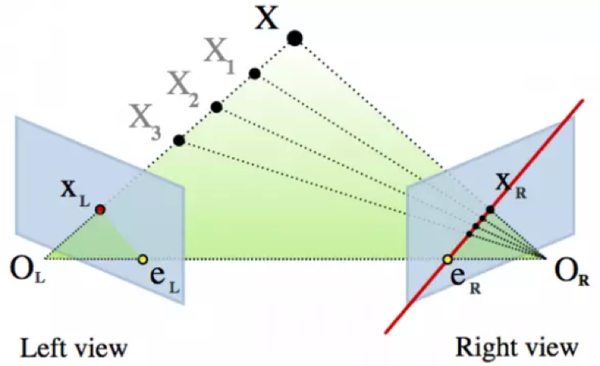

软件处理编译拍摄视频时,已知每两个摄像头之间的相对距离、位置,因此只需能计算出两个摄像头之间的场景像素,就能得到场景中某个点的深度。通俗一点讲:两点能确定一条线,已知的两条线交叉处就能确定一个点的深度距离,然后无数多个这样的点组成了虚拟世界中物体的深度信息。

当你找到匹配的区域,同时也知道在图片上这些区域的距离差,你就能计算出相机阵列和这个区域实物之间的距离。当物体离相机很近时,物体在画面上会变大。如果物体在无限远,那么两个相邻相机照出来的图片天空部位会非常接近。

3、移动VR眼镜

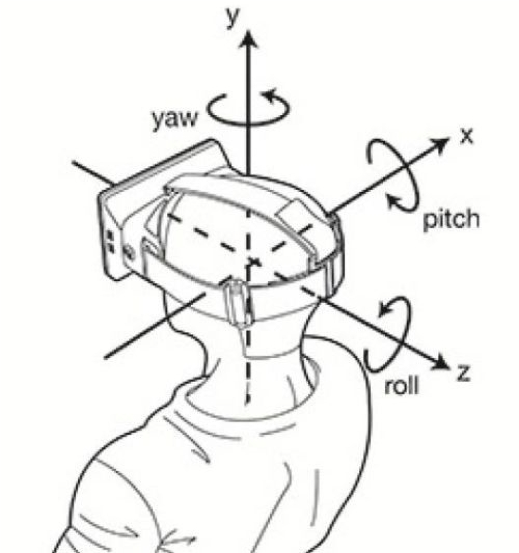

它的原理很简单,利用三轴陀螺仪、重力感应器等体位传感器的帮助,用户所看到的画面可以跟随佩戴者头部的移动而做出相应的反应,产生近似现实的视觉反馈。让视觉内容可以根据用户头部运动而作出相应反馈,并提供了实时的操纵方式。

转载自:http://www.mobileui.cn/designers-should-popularize-vr-industry-information.html